英伟达CEO黄仁勋在一次公开演讲中提出了一个引人深思的观点:未来的软件将主要由人工智能(AI)监督机器人自动编写,人类开发者的角色将更多转向设计、审核与战略规划。这一设想迅速在科技界引发热议,其中特斯拉与SpaceX的CEO埃隆·马斯克在社交媒体上幽默回应:“看来即使AI也逃不过中间管理层。”这句调侃不仅增添了讨论的趣味,更折射出人工智能在应用软件开发领域引发的深刻变革与挑战。

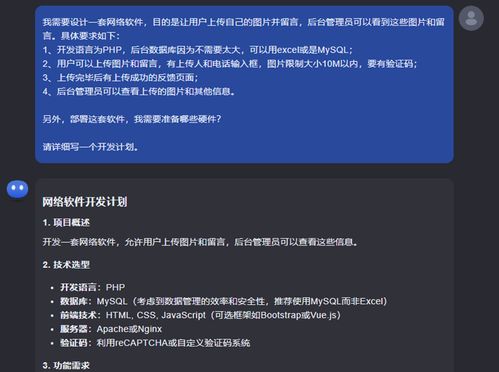

黄仁勋的预言基于AI技术的飞速发展,尤其是生成式AI和自动化编程工具的成熟。他认为,未来的软件开发流程中,AI将能够理解自然语言描述的需求,自动生成高效、可靠的代码,并通过机器学习不断优化。而人类工程师则扮演“监督者”角色,负责设定目标、确保代码符合伦理与安全标准,并处理复杂系统集成等高层任务。这种模式有望大幅提升开发效率,降低人力成本,并减少人为错误,特别是在重复性编码任务中。

马斯克的幽默回应触及了一个关键问题:如果AI主导编程,是否也会催生新的“官僚层级”?在传统软件开发中,中间管理层常负责协调、监督与资源分配;而在AI驱动的类似的监督机制可能以算法形式存在,例如AI系统需要多层验证、决策流程或伦理审查模块。这暗示着,即使技术高度自动化,软件开发仍可能保留一定的层级结构,只是从人类转向了机器智能的“自我管理”。这种变化既可能带来效率提升,也可能引发对透明度、可控性的新担忧。

从应用软件开发的实际场景来看,AI的介入已初见端倪。当前,低代码平台和AI辅助编程工具(如GitHub Copilot)正逐步普及,它们能根据上下文提示自动生成代码片段,帮助开发者快速完成基础工作。黄仁勋所设想的“AI监督机器人”则是这一趋势的延伸:AI可能不仅生成代码,还能自主测试、调试甚至部署软件,形成端到端的自动化开发管道。这意味着更快的产品迭代周期和更灵活的响应能力;但对开发者而言,也要求技能转型,从编码转向更侧重创意、架构设计与AI系统治理。

值得注意的是,这一未来并非没有挑战。安全性问题凸显:如果软件完全由AI编写,如何确保它没有隐藏漏洞或被恶意操控?伦理与偏见风险:AI的训练数据可能包含社会偏见,导致生成的代码隐含歧视性逻辑。马斯克提到的“中间管理层”幽默背后,实际指向了AI决策的可解释性难题——当AI监督AI时,人类如何理解并干预其决策过程?这些都需要行业在技术标准、法规框架上未雨绸缪。

黄仁勋与马斯克的对话勾勒出人工智能在应用软件开发中的双面图景:一方面,自动化将解放人力,推动创新进入新阶段;另一方面,它也将重塑工作流程,并带来管理、伦理上的新课题。对于开发者和企业,拥抱AI工具的培养跨领域技能、建立人机协作的治理体系,将是应对未来的关键。正如马斯克所调侃的,或许在AI的世界里,“管理”不再是人类专属,但如何让这种管理更高效、更公平,依然需要我们深思熟虑。